De dashboard a copiloto: Por qué las herramientas de Retail Intelligence tradicionales se quedan cortas en la era de los LLMs

TL;DR

El Retail Intelligence tradicional tiene dificultades para convertir datos en decisiones rápidas y accionables. Los LLMs cambian este paradigma al permitir interacción en lenguaje natural, mayor contextualización y análisis proactivo. Soluciones como Tyrell AI de flipflow llevan este enfoque a la práctica, convirtiendo el análisis en un copiloto que guía decisiones en tiempo real.

Introducción: El techo de cristal del BI

El retail lleva años invirtiendo millones en plataformas de Business Intelligence. Dashboards con decenas de KPIs, informes automatizados, alertas de stock, comparativas de sell-out por canal… Todo eso existe, funciona y tiene valor. Pero hay un momento en que el equipo que trabaja con esas herramientas se topa con una pared invisible: los datos están ahí, pero transformarlos en decisiones rápidas, contextualizadas y accionables sigue siendo lento, manual y dependiente de perfiles técnicos.

Ese techo de cristal no es un problema de cantidad de datos. Muchas empresas tienen más datos de los que pueden procesar. El problema está en cómo esas herramientas están diseñadas para interactuar con la información, y para quién.

Los Large Language Models (LLMs) abren una grieta en ese techo. Pero antes de hablar de lo que cambia, conviene entender bien qué es hoy el Retail Intelligence y dónde falla.

Qué entendemos por Retail Intelligence hoy

El Retail Intelligence engloba el conjunto de herramientas, procesos y metodologías que permiten a fabricantes, distribuidores y retailers recopilar, procesar y analizar datos del mercado para entender el rendimiento en el lineal, el comportamiento del cliente y las dinámicas de mercado, con el objetivo de traducir esos datos en decisiones concretas. Incluye tanto el canal físico como el digital, y conecta métricas de tráfico, conversión, precios, promociones y disponibilidad con resultados de negocio.

En la práctica, un sistema de Retail Intelligence se apoya en cuatro pilares:

- Recogida de datos desde TPVs, e-commerce, marketplaces, sensores in‑store y contadores de tráfico.

- Integración de datos internos (ventas, inventario) con señales externas (precios de la competencia, reviews, promociones, paneles).

- Analítica y visualización mediante dashboards, informes periódicos y alertas automatizadas.

- Soporte a la decisión, conectando insights con acciones como cambios de surtido, ajustes de precios o modificaciones en planogramas.

El objetivo es claro: transformar datos en visibilidad de negocio. El problema aparece cuando esa visibilidad no se convierte con suficiente rapidez en acción.

El Retail Intelligence tradicional destaca en la parte descriptiva. Responde bien a preguntas como “qué se vendió”, “dónde cayó la facturación” o “qué promoción funcionó mejor”. Lo que le cuesta más es conectar causas, contexto y siguientes pasos. Esa brecha pesa mucho más en un entorno omnicanal, donde el volumen de información crece y las señales relevantes están dispersas entre fuentes estructuradas y no estructuradas.

Dónde se queda corto el Retail Intelligence tradicional

Las soluciones de Retail Intelligence tradicionales han aportado mucho valor, pero se diseñaron para un entorno menos volátil, con menos fuentes de datos y menos necesidad de respuesta en tiempo real. Esa herencia genera fricciones cuando se les pide operar al ritmo del retail actual.

Mira al pasado más que al presente

Las herramientas clásicas de BI están diseñadas para analizar resultados cerrados: semana anterior, cierre mensual o evolución trimestral. Ese enfoque aporta visibilidad, pero llega tarde en mercados que cambian a diario.

En categorías de alta rotación o fuerte presión promocional —como droguería, alimentación fresca o bebidas— ese desfase puede suponer perder posición frente a competidores más ágiles.

Según el Shopping Index de Salesforce, el consumidor es cada vez más dinámico, con recorridos de compra que combinan canales, dispositivos y momentos del día. En este contexto, el análisis exclusivamente retrospectivo limita la capacidad de reacción: cuando el problema se detecta, parte de la oportunidad ya se ha perdido.

Aun así, el análisis en tiempo real o casi en tiempo real sigue siendo la excepción en gran parte del gran consumo.

Silos de datos y poca granularidad

Los paneles de consumidores miden hogares, no transacciones individuales. El dato de caja de distribuidor tiene granularidad de producto y tienda, pero no siempre se comparte de forma sistemática. El dato de la fuerza de ventas captura lo que los GPVs reportan en sus visitas, con toda la variabilidad que eso implica. Y el dato de e-commerce opera con una lógica completamente diferente.

El resultado es un ecosistema fragmentado donde el mismo KPI, por ejemplo, la cuota de mercado de un SKU en gran superficie, puede variar significativamente según la fuente que se consulte. Reconciliar esas diferencias consume tiempo analítico que podría dedicarse a generar valor.

Además, los niveles de desagregación no siempre permiten el análisis que el negocio necesita: entender qué ocurre con una referencia concreta en una cadena y región específicas suele requerir customizaciones, ya que muchos proveedores solo ofrecen datos agregados por categoría o retailer. Esta falta de granularidad limita el análisis a nivel de SKU, tienda, formato o atributo, dificultando identificar qué variantes traccionan o qué puntos de venta presentan roturas de stock de forma consistente.

Los insights no escalan bien

En muchas organizaciones, el acceso al insight depende de unos pocos perfiles: analistas, equipos de BI o data specialists. Ellos construyen consultas, preparan informes y responden preguntas de negocio. Ese proceso funciona razonablemente bien cuando hay pocos mercados, pocas categorías y pocos interlocutores.

El problema aparece cuando toda la compañía quiere respuestas rápidas. El category manager necesita entender un desvío de margen. Trade marketing quiere comparar promociones entre regiones. Operaciones necesita detectar una anomalía en disponibilidad. Si cada nueva pregunta requiere un ticket, una extracción y una validación manual, el insight escala mal.

Los equipos de insights se convierten en cuellos de botella. Las solicitudes se acumulan. Y las decisiones se toman con información incompleta o desactualizada.

Fragmentación de fuentes

El retail actual genera información útil en muchos formatos y canales:

- Datos transaccionales

- Imágenes y auditorías de tienda

- Reseñas de producto

- Tickets de soporte

- Conversaciones con cliente

- Informes internos

- Seguimiento de precios de competidores

Una organización mediana de gran consumo puede trabajar simultáneamente con datos de panel de consumidor, datos de caja de uno o varios distribuidores, un CRM propio, una herramienta de ejecución en el punto de venta, plataformas de e-commerce con su propia analítica, datos de redes sociales y herramientas de digital shelf analytics.

Cada una de estas fuentes tiene su propia estructura, su propia cadencia, su propia lógica de acceso y su propio equipo de gestión. Muy pocas organizaciones han conseguido integrarlas de forma coherente en una capa analítica unificada. La mayoría trabaja con cada fuente por separado, cruzando datos manualmente cuando es necesario.

Esa fragmentación genera inconsistencias, errores de interpretación y una visión parcial de la realidad del mercado.

Mucho reporte, poca acción

El foco en la producción de informes y dashboards suele derivar en una paradoja: abundancia de gráficos, pero escasez de decisiones. Muchos cuadros de mando se limitan a mostrar indicadores sin traducirlos en recomendaciones operativas, obligando al usuario a interpretar por su cuenta qué hacer con variaciones de margen o caídas de penetración.

Esta brecha entre insight y ejecución se amplía cuando la información no está conectada con sistemas de acción —como pricing, promociones o planificación de inventario—, y cuando el propio formato (tablas, gráficos, comparativas) exige un esfuerzo cognitivo adicional de interpretación y priorización. El resultado es un BI que ha optimizado la generación de reportes, pero no la activación de cambios: se consumen datos, pero rara vez se convierten en decisiones.

Problemas de calidad, matching y mantenimiento

Más allá de las limitaciones analíticas, hay un problema operativo constante: la calidad del dato. Los errores de codificación de producto, los cambios de nomenclatura entre distribuidores, los problemas de matching entre referencias propias y referencias en el punto de venta, los datos duplicados o faltantes… Todo eso genera un mantenimiento continuo que consume recursos y erosiona la confianza en los análisis.

En categorías con portfolios amplios o con alta rotación de referencias este problema es especialmente agudo. Las tablas maestras de producto se desactualizan. Los algoritmos de matching fallan con nuevos lanzamientos. Y el equipo de datos pasa parte de su tiempo limpiando en lugar de analizando.

Cada nueva fuente requiere reglas, mappings y mantenimiento continuo. Cuando el dato base tiene grietas, el dashboard gana en estética pero pierde en fiabilidad.

Qué cambia con la llegada de los LLMs

Los modelos de lenguaje de gran escala no son simplemente una mejora incremental sobre las herramientas existentes. Representan un cambio en la capa de interacción con los datos, en la capacidad de contextualización y en la velocidad con la que una organización puede pasar del dato a la acción.

Estos modelos permiten conectar múltiples fuentes estructuradas y no estructuradas, traducirlas a lenguaje natural y generar respuestas y recomendaciones más cercanas a cómo piensan los equipos comerciales, de marketing o de operaciones. Esto reduce fricciones de adopción y abre el uso de la inteligencia de datos a perfiles que antes se quedaban en la superficie del dashboard.

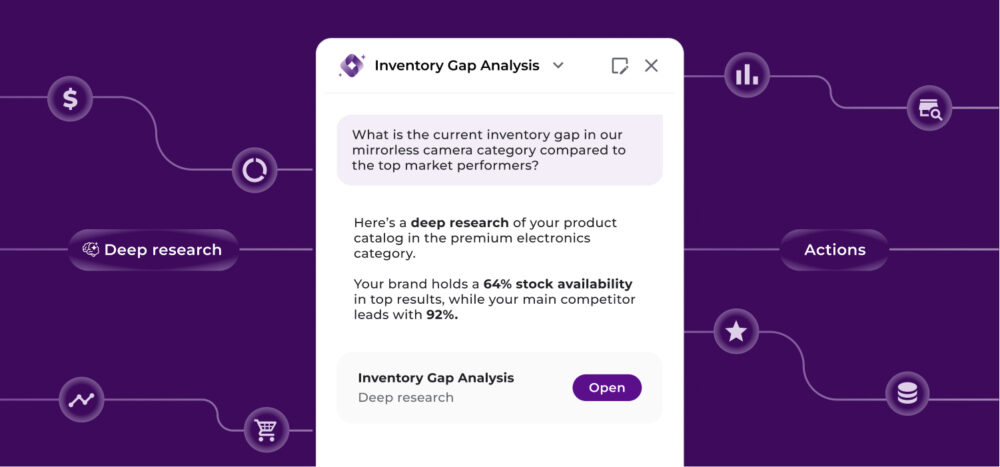

1. Interacción en lenguaje natural sobre los datos

La primera y más obvia transformación es la interfaz. Con un LLM integrado sobre las fuentes de datos correctas, un KAM puede preguntar: «¿En qué cadenas ha caído más el sell-out de nuestra referencia principal en las últimas cuatro semanas, y cómo se compara con el mercado?» y recibir una respuesta estructurada, sin necesidad de abrir un dashboard, aplicar filtros o esperar a que el equipo de insights construya el análisis.

Esto democratiza el acceso a la información. Perfiles que hoy dependen de intermediarios analíticos (directores comerciales, brand managers, key account managers) pueden acceder directamente a la inteligencia que necesitan para sus reuniones, sus negociaciones o sus decisiones de portfolio.

El lenguaje natural reduce la distancia entre negocio y dato. El usuario no necesita saber cómo está construida la consulta ni dominar una herramienta compleja para empezar a explorar. Con una buena arquitectura de acceso y control, el dato se vuelve más accesible para perfiles no técnicos.

2. Más contexto y capacidad explicativa

Los LLMs aportan algo especialmente valioso: capacidad para leer y resumir grandes volúmenes de información no estructurada. Pueden analizar reseñas, incidencias, chats, correos, informes de tienda y documentación interna para detectar temas recurrentes o explicar

Un LLM bien configurado sobre datos de retail puede ir más allá de describir lo que ha pasado. Puede contextualizar: «Esta caída de cuota coincide con el lanzamiento de una promoción del competidor principal en el mismo período y con una ruptura de stock en dos de las cinco cadenas analizadas.»

Esa capacidad explicativa es muy difícil de replicar con herramientas de BI tradicionales, que presentan los datos pero no los interpretan. El analista humano hace ese trabajo de conexión de contextos, pero solo puede hacerlo para una fracción de las preguntas que el negocio necesita responder.

Los LLMs pueden procesar simultáneamente múltiples señales y generar una narrativa coherente que ayude al responsable de decisión a entender no solo qué ha pasado, sino por qué.

3. Operaciones más ágiles y decisiones proactivas

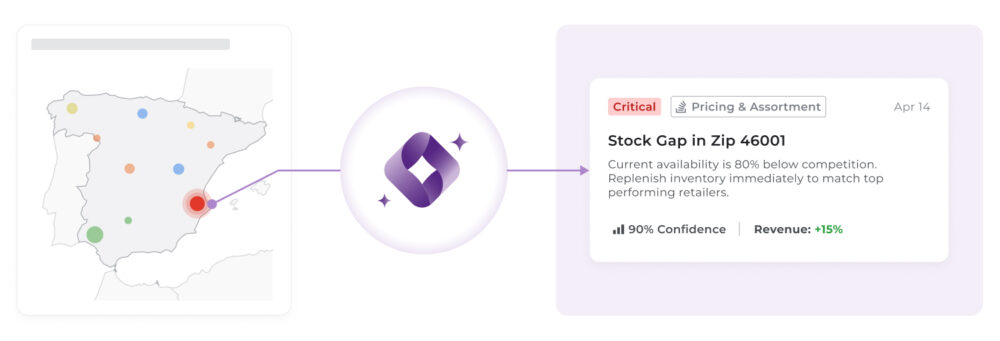

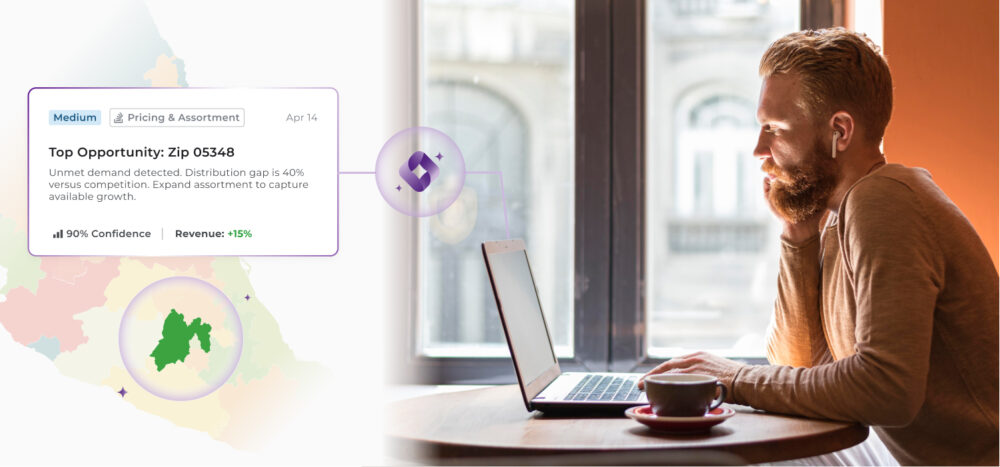

Otra dimensión relevante es el paso de la analítica reactiva a la proactiva. Los sistemas tradicionales responden a preguntas que alguien formula. Los sistemas basados en LLMs pueden estar configurados para detectar anomalías, identificar oportunidades y generar alertas antes de que el usuario formule la pregunta.

Un sistema de Retail Intelligence aumentado con LLMs puede avisar: «La referencia X en la cadena Y lleva tres semanas con una pérdida de facing por debajo del estándar acordado. Históricamente, esto precede una caída de sell-out de entre un 8% y un 12% en las cuatro semanas siguientes.» Eso convierte el sistema en un radar comercial, no solo en un espejo retrovisor.

4. Del dashboard al copiloto de decisión

La suma de estas capacidades (lenguaje natural, contextualización, proactividad) configura un nuevo tipo de herramienta: el copiloto de decisión. En lugar de abrir un dashboard y extraer manualmente conclusiones, el usuario tiene una conversación con el sistema. Le formula hipótesis, recibe análisis, explora alternativas y llega a una recomendación de acción con mucho menos esfuerzo cognitivo.

Este cambio tiene implicaciones organizativas importantes. Reduce la dependencia de los equipos de analítica para tareas de reporting estándar, libera tiempo para trabajo de mayor valor y acelera los ciclos de decisión en toda la organización comercial. Esa dinámica acerca el análisis al momento real de decisión.

Lo que los LLMs no resuelven por sí solos

Es importante no sobredimensionar las expectativas. Los LLMs son potentes, pero tienen limitaciones relevantes en el contexto del Retail Intelligence.

- La calidad del dato sigue siendo determinante: Un LLM que trabaja sobre datos mal estructurados, con errores de matching o con fuentes desactualizadas generará respuestas incorrectas con más fluidez y convicción que una herramienta tradicional. El garbage in, garbage out se aplica con más fuerza, no con menos.

- La integración de fuentes sigue siendo un reto técnico: Para que un LLM pueda responder sobre sell-out, precios, ejecución en tienda y datos de competencia de forma coherente, alguien tiene que haber construido la arquitectura de datos que lo hace posible. Eso requiere inversión, tiempo y competencias técnicas que no están al alcance de todas las organizaciones.

- La alucinación es un riesgo real: Los LLMs pueden generar respuestas plausibles pero incorrectas, especialmente cuando se les pregunta sobre datos muy específicos o cuando la información de contexto es incompleta. Cualquier implementación de este tipo de sistemas en entornos de decisión comercial necesita mecanismos de gobernanza, verificación y supervisión humana.

- El conocimiento del dominio sigue siendo necesario. Un LLM no sabe intrínsecamente qué significa una caída de distribución numérica en un canal específico para una categoría concreta. Ese contexto tiene que construirse, ya sea mediante prompts bien diseñados, mediante fine-tuning o mediante la integración de conocimiento experto en la arquitectura del sistema.

No es el fin del Retail Intelligence: es su evolución

El problema no ha sido nunca el dato, sino la distancia entre el dato y la decisión. A lo largo del artículo hemos visto cómo el Retail Intelligence tradicional se queda corto no por falta de capacidades analíticas, sino por fricciones estructurales: enfoque retrospectivo, fragmentación de fuentes, falta de granularidad y una dependencia excesiva de dashboards que informan, pero no guían la acción. Los LLMs no sustituyen ese ecosistema; lo reconfiguran, acercando el análisis al momento real de decisión y reduciendo el esfuerzo necesario para convertir información en impacto.

En este contexto, flipflow, a través de nuestro copiloto y sistema proactivo de toma de decisiones Tyrell AI, ofrece un enfoque integrado. Consolidamos datos del retail como rendimiento en el lineal, dinámicas de precios, cobertura de distribución y percepción de los consumidores en una única capa de inteligencia, y permitimos interactuar con ellos mediante lenguaje natural, cruzando señales dispersas y generando recomendaciones precisas y accionables. Tyrell AI acelera la obtención de respuestas y, además, anticipa problemas, prioriza oportunidades y vincula directamente el análisis con decisiones comerciales estratégicas.

Por otro lado, no eliminamos la necesidad de una buena arquitectura de datos —la hacemos más crítica—, pero sí redefinimos quién puede extraer valor de ella y a qué velocidad. Tyrell AI democratiza el acceso al insight sin perder profundidad analítica, reduce la dependencia de flujos manuales y convierte el Retail Intelligence en un sistema activo, más cercano a un radar que a un informe.

El resultado es un cambio de paradigma: del dashboard como punto de llegada al copiloto como punto de partida. Porque en un entorno donde la ventaja competitiva depende de reaccionar antes que el mercado, no gana quien más datos tiene, sino quien mejor los convierte en decisiones.