De Dashboard a Copiloto: Por que as Ferramentas de Retail Intelligence Tradicionais Ficam Aquém na Era dos LLMs

TL;DR

O Retail Intelligence tradicional tem dificuldade em converter dados em decisões rápidas e acionáveis. Os LLMs mudam esse paradigma ao permitir a interação em linguagem natural, maior contextualização e análise proativa. Soluções como o Tyrell AI da flipflow colocam essa abordagem em prática, transformando a análise em um copiloto que guia decisões em tempo real.

Introdução: O Teto de Vidro do BI

O setor de varejo vem investindo milhões em plataformas de Business Intelligence há anos. Dashboards com dezenas de KPIs, relatórios automatizados, alertas de estoque, comparações de sell-out por canal… Tudo isso existe, funciona e tem valor. Mas chega um ponto em que as equipes que trabalham com essas ferramentas batem em uma parede invisível: os dados estão lá, mas transformá-los em decisões rápidas, contextualizadas e acionáveis continua sendo lento, manual e dependente de perfis técnicos.

Esse teto de vidro não é um problema de quantidade de dados. Muitas empresas têm mais dados do que conseguem processar. O problema reside na forma como essas ferramentas são projetadas para interagir com a informação e para quem são destinadas.

Os Large Language Models (LLMs) estão rachando esse teto. No entanto, antes de discutir o que está mudando, vale a pena entender exatamente o que é o Retail Intelligence hoje e onde ele falha.

O que entendemos por Retail Intelligence hoje

O Retail Intelligence engloba o conjunto de ferramentas, processos e metodologias que permitem a fabricantes, distribuidores e varejistas coletar, processar e analisar dados de mercado para entender o desempenho nas gôndolas, o comportamento do cliente e as dinâmicas de mercado, com o objetivo de traduzir esses dados em decisões concretas. Inclui tanto os canais físicos quanto os digitais, conectando métricas de tráfego, conversão, preços, promoções e disponibilidade com os resultados do negócio.

Na prática, um sistema de Retail Intelligence baseia-se em quatro pilares:

- Coleta de dados de PDV (Ponto de Venda), e-commerce, marketplaces, sensores em loja e contadores de fluxo.

- Integração de dados internos (vendas, inventário) com sinais externos (preços da concorrência, avaliações, promoções, painéis).

- Analytics e visualização por meio de dashboards, relatórios periódicos e alertas automatizados.

- Suporte à decisão, conectando insights com ações como mudanças de sortimento, ajustes de preços ou modificações em planogramas.

O objetivo é claro: transformar dados em visibilidade de negócio. O problema surge quando essa visibilidade não se transforma em ação com rapidez suficiente.

Retail Intelligence tradicional se destaca na parte descritiva. Ele responde bem a perguntas como “o que foi vendido”, “onde o faturamento caiu” ou “qual promoção funcionou melhor”. O que ele acha mais difícil é conectar causas, contexto e próximos passos. Essa lacuna é muito mais significativa em um ambiente omnichannel, onde o volume de informações cresce e os sinais relevantes estão dispersos em fontes estruturadas e não estruturadas.

Onde o Retail Intelligence Tradicional Falha

As soluções tradicionais de Retail Intelligence agregaram muito valor, mas foram projetadas para um ambiente menos volátil, com menos fontes de dados e menos necessidade de resposta em tempo real. Esse legado cria atritos quando se exige que operem no ritmo do varejo atual.

Olha para o passado mais do que para o presente

As ferramentas clássicas de BI são projetadas para analisar resultados fechados: a semana anterior, o fechamento mensal ou a evolução trimestral. Essa abordagem fornece visibilidade, mas chega tarde em mercados que mudam diariamente.

Em categorias de alta rotatividade ou com forte pressão promocional — como limpeza doméstica, alimentos frescos ou bebidas — esse atraso pode significar a perda de posição para concorrentes mais ágeis.

De acordo com o Shopping Index da Salesforce, os consumidores são cada vez mais dinâmicos, com jornadas de compra que combinam canais, dispositivos e momentos do dia. Nesse contexto, a análise exclusivamente retrospectiva limita a capacidade de reação: quando o problema é detectado, parte da oportunidade já foi perdida.

Ainda assim, a análise em tempo real ou quase em tempo real continua sendo a exceção em grande parte do setor de bens de consumo (FMCG).

Silos de dados e baixa granularidade

Painéis de consumidores medem domicílios, não transações individuais. Os dados de frente de caixa do distribuidor têm granularidade de produto e loja, mas nem sempre são compartilhados de forma sistemática. Os dados da força de vendas capturam o que os representantes de campo relatam durante suas visitas, com toda a variabilidade que isso implica. E os dados de e-commerce operam com uma lógica completamente diferente.

O resultado é um ecossistema fragmentado onde o mesmo KPI, por exemplo, a participação de mercado de um SKU em um supermercado, pode variar significativamente dependendo da fonte consultada. Reconciliar essas diferenças consome tempo analítico que poderia ser dedicado a gerar valor.

Além disso, os níveis de desagregação nem sempre permitem a análise que o negócio precisa: entender o que está acontecendo com uma referência específica em uma rede e região específicas geralmente requer customização, pois muitos provedores oferecem apenas dados agregados por categoria ou varejista. Essa falta de granularidade limita a análise ao nível de SKU, loja, formato ou atributo, dificultando a identificação de quais variantes estão ganhando tração ou quais pontos de venda estão sofrendo rupturas de estoque de forma consistente.

Os insights não escalam bem

Em muitas organizações, o acesso aos insights depende de alguns perfis: analistas, equipes de BI ou especialistas em dados. Eles constroem consultas, preparam relatórios e respondem a perguntas de negócio. Esse processo funciona razoavelmente bem quando há poucos mercados, poucas categorias e poucos interlocutores.

O problema surge quando a empresa inteira quer respostas rápidas. O gerente de categoria precisa entender um desvio de margem. Trade marketing quer comparar promoções entre regiões. Operações precisa detectar uma anomalia na disponibilidade. Se cada nova pergunta exigir um ticket, uma extração e uma validação manual, o insight escala mal.

As equipes de insights tornam-se gargalos. As solicitações se acumulam. E as decisões são tomadas com informações incompletas ou desatualizadas.

Fragmentação de fontes

O varejo atual gera informações úteis em muitos formatos e canais:

- Dados transacionais

- Imagens de loja e auditorias

- Avaliações de produtos

- Tickets de suporte

- Conversas com clientes

- Relatórios internos

- Monitoramento de preços da concorrência

Uma organização de médio porte de bens de consumo pode trabalhar simultaneamente com dados de painel de consumidores, dados de caixa de um ou vários distribuidores, seu próprio CRM, uma ferramenta de execução de ponto de venda, plataformas de e-commerce com seus próprios analytics, dados de redes sociais e ferramentas de digital shelf analytics.

Cada uma dessas fontes tem sua própria estrutura, sua própria cadência, sua própria lógica de acesso e sua própria equipe de gestão. Pouquíssimas organizações conseguiram integrá-las de forma coerente em uma camada analítica unificada. A maioria trabalha com cada fonte separadamente, cruzando dados manualmente quando necessário.

Essa fragmentação gera inconsistências, erros de interpretação e uma visão parcial da realidade do mercado.

Muito relatório, pouca ação

O foco na produção de relatórios e dashboards muitas vezes leva a um paradoxo: abundância de gráficos, mas escassez de decisões. Muitos dashboards limitam-se a mostrar indicadores sem traduzi-los em recomendações operacionais, forçando o usuário a interpretar por conta própria o que fazer com variações de margem ou quedas na penetração.

Essa lacuna entre insight e execução aumenta quando a informação não está conectada a sistemas de ação — como precificação, promoções ou planejamento de inventário — e quando o próprio formato (tabelas, gráficos, comparações) exige um esforço cognitivo adicional de interpretação e priorização. O resultado é um BI que otimizou a geração de relatórios, mas não a ativação de mudanças: consomem-se dados, mas raramente eles são convertidos em decisões.

Problemas de qualidade, correspondência e manutenção

Além das limitações analíticas, existe um problema operacional constante: a qualidade do dado. Erros de codificação de produtos, mudanças de nomenclatura entre distribuidores, problemas de correspondência (matching) entre referências próprias e no ponto de venda, dados duplicados ou ausentes… Tudo isso gera uma manutenção contínua que consome recursos e corrói a confiança nas análises.

Em categorias com portfólios amplos ou com alta rotatividade de referências, esse problema é especialmente agudo. As tabelas mestras de produtos ficam desatualizadas. Os algoritmos de matching falham com novos lançamentos. E a equipe de dados gasta parte do seu tempo limpando em vez de analisar.

Cada nova fonte exige regras, mapeamentos e manutenção contínua. Quando o dado base tem falhas, o dashboard ganha em estética, mas perde em confiabilidade.

O que muda com a chegada dos LLMs

Modelos de linguagem de grande escala não são apenas uma melhoria incremental sobre as ferramentas existentes. Eles representam uma mudança na camada de interação com os dados, na capacidade de contextualização e na velocidade com que uma organização pode passar do dado para a ação.

Esses modelos permitem conectar múltiplas fontes estruturadas e não estruturadas, traduzi-las para linguagem natural e gerar respostas e recomendações mais próximas de como as equipes comercial, de marketing ou de operações pensam. Isso reduz o atrito na adoção e abre o uso da inteligência de dados para perfis que antes ficavam apenas na superfície do dashboard.

1. Interação em linguagem natural sobre os dados

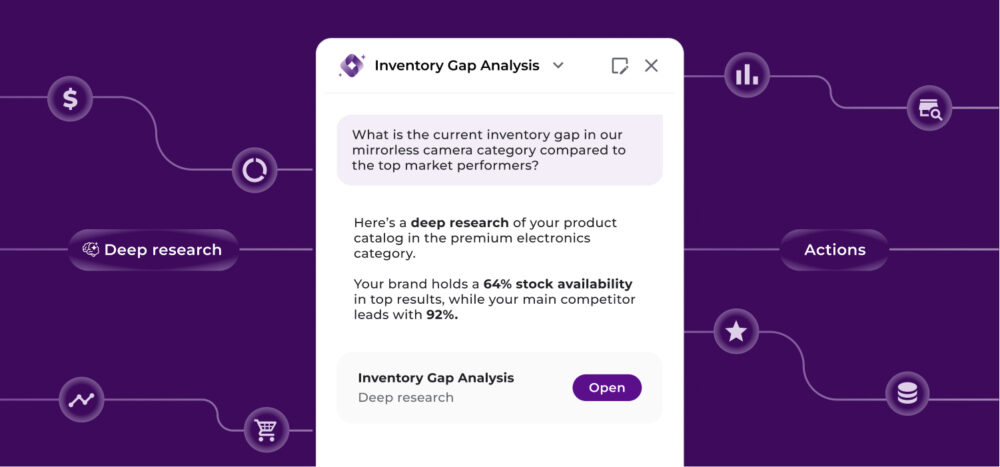

A primeira e mais óbvia transformação é a interface. Com um LLM integrado às fontes de dados corretas, um KAM (Key Account Manager) pode perguntar: “Em quais redes o sell-out da nossa principal referência mais caiu nas últimas quatro semanas e como isso se compara ao mercado?” e receber uma resposta estruturada sem precisar abrir um dashboard, aplicar filtros ou esperar que a equipe de insights construa a análise.

Isso democratiza o acesso à informação. Perfis que hoje dependem de intermediários analíticos (diretores comerciais, brand managers, key account managers) podem acessar diretamente a inteligência de que precisam para suas reuniões, negociações ou decisões de portfólio.

A linguagem natural reduz a distância entre negócio e dado. O usuário não precisa saber como a consulta é construída nem dominar uma ferramenta complexa para começar a explorar. Com uma boa arquitetura de acesso e controle, o dado torna-se mais acessível para perfis não técnicos.

2. Mais contexto e capacidade explicativa

Os LLMs trazem algo especialmente valioso: a capacidade de ler e resumir grandes volumes de informações não estruturadas. Eles podem analisar avaliações, incidentes, chats, e-mails, relatórios de loja e documentação interna para detectar temas recorrentes ou explicar tendências.

Um LLM bem configurado sobre dados de varejo pode ir além de descrever o que aconteceu. Ele pode contextualizar: “Essa queda de participação coincide com o lançamento de uma promoção do principal concorrente no mesmo período e com uma ruptura de estoque em duas das cinco redes analisadas.”

Essa capacidade explicativa é muito difícil de replicar com ferramentas de BI tradicionais, que apresentam os dados, mas não os interpretam. O analista humano faz esse trabalho de conexão de contextos, mas só consegue fazê-lo para uma fração das perguntas que o negócio precisa responder.

Os LLMs podem processar simultaneamente múltiplos sinais e gerar uma narrativa coerente que ajude o tomador de decisão a entender não apenas o que aconteceu, mas por quê.

3. Operações mais ágeis e decisões proativas

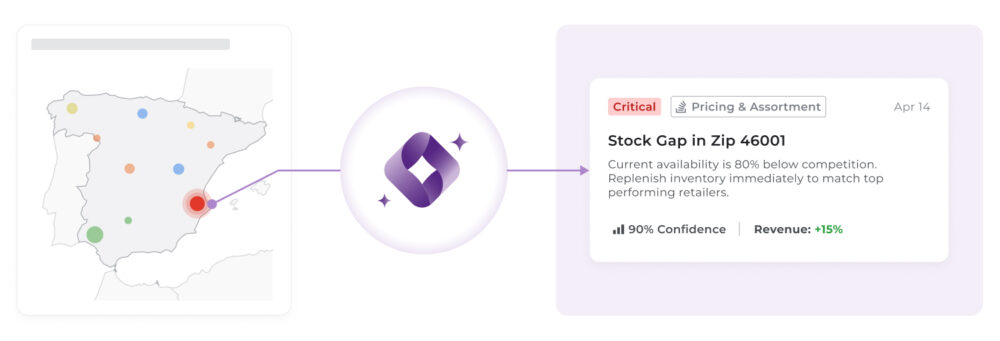

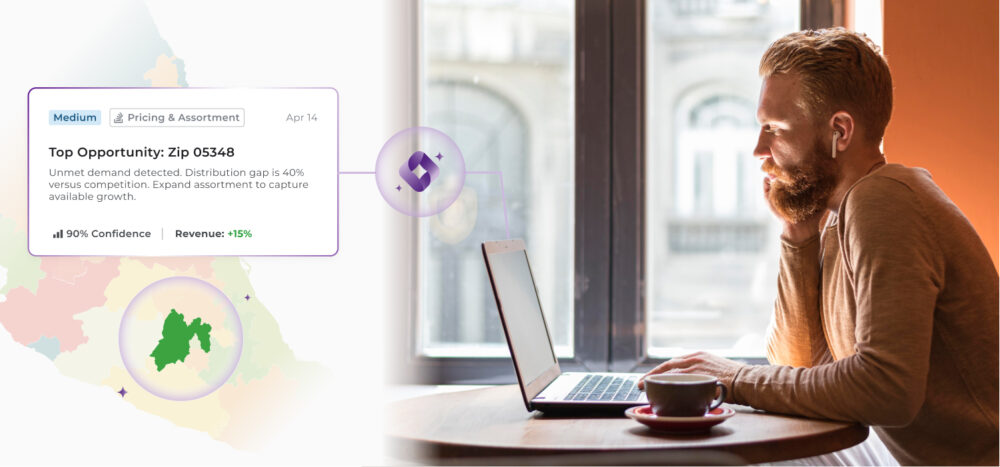

Outra dimensão relevante é a passagem da análise reativa para a proativa. Os sistemas tradicionais respondem a perguntas que alguém faz. Os sistemas baseados em LLMs podem ser configurados para detectar anomalias, identificar oportunidades e gerar alertas antes mesmo que o usuário faça a pergunta.

Um sistema de Retail Intelligence aumentado com LLMs pode avisar: “A referência X na rede Y está há três semanas com uma perda de facing abaixo do padrão acordado. Historicamente, isso precede uma queda de sell-out entre 8% e 12% nas quatro semanas seguintes.” Isso transforma o sistema em um radar comercial, não apenas em um espelho retrovisor.

4. De dashboard a copiloto de decisão

A soma dessas capacidades (linguagem natural, contextualização, proatividade) configura um novo tipo de ferramenta: o copiloto de decisão. Em vez de abrir um dashboard e extrair manualmente as conclusões, o usuário conversa com o sistema. Ele formula hipóteses, recebe análises, explora alternativas e chega a uma recomendação de ação com muito menos esforço cognitivo.

Essa mudança tem implicações organizacionais importantes. Reduz a dependência das equipes de analytics para tarefas de relatórios padrão, libera tempo para trabalhos de maior valor e acelera os ciclos de decisão em toda a organização comercial. Essa dinâmica aproxima a análise do momento real da decisão.

O que os LLMs não resolvem sozinhos

É importante não superdimensionar as expectativas. Os LLMs são poderosos, mas têm limitações relevantes no contexto do Retail Intelligence.

- A qualidade do dado continua sendo determinante: Um LLM que trabalha sobre dados mal estruturados, com erros de correspondência ou com fontes desatualizadas gerará respostas incorretas com mais fluidez e convicção do que uma ferramenta tradicional. O conceito de garbage in, garbage out aplica-se com mais força, não menos.

- A integração de fontes continua sendo um desafio técnico: Para que um LLM consiga responder sobre sell-out, preços, execução em loja e dados da concorrência de forma coerente, alguém precisa ter construído a arquitetura de dados que torne isso possível. Isso exige investimento, tempo e competências técnicas que não estão ao alcance de todas as organizações.

- A alucinação é um risco real: Os LLMs podem gerar respostas plausíveis, mas incorretas, especialmente quando questionados sobre dados muito específicos ou quando a informação de contexto é incompleta. Qualquer implementação desse tipo de sistema em ambientes de decisão comercial precisa de mecanismos de governança, verificação e supervisão humana.

- O conhecimento de domínio ainda é necessário. Um LLM não sabe intrinsecamente o que significa uma queda de distribuição numérica em um canal específico para uma categoria concreta. Esse contexto precisa ser construído, seja por meio de prompts bem elaborados, por meio de fine-tuning ou pela integração de conhecimento especializado na arquitetura do sistema.

Não é o Fim do Retail Intelligence: É a Sua Evolução

O problema nunca foi o dado, mas a distância entre o dado e a decisão. Ao longo deste artigo, vimos como o Retail Intelligence tradicional fica aquém não por falta de capacidades analíticas, mas por atritos estruturais: foco retrospectivo, fragmentação de fontes, falta de granularidade e uma dependência excessiva de dashboards que informam, mas não guiam a ação. Os LLMs não substituem esse ecossistema; eles o reconfiguram, aproximando a análise do momento real de decisão e reduzindo o esforço necessário para converter informação em impacto.

Nesse contexto, a flipflow, por meio do nosso copiloto e sistema proativo de tomada de decisões Tyrell AI, oferece uma abordagem integrada. Consolidamos dados do varejo, como desempenho nas gôndolas, dinâmica de preços, cobertura de distribuição e percepção dos consumidores, em uma única camada de inteligência, permitindo a interação por meio de linguagem natural, cruzando sinais dispersos e gerando recomendações precisas e acionáveis. O Tyrell AI acelera a obtenção de respostas e, além disso, antecipa problemas, prioriza oportunidades e vincula diretamente a análise às decisões comerciais estratégicas.

Por outro lado, não eliminamos a necessidade de uma boa arquitetura de dados — nós a tornamos mais crítica — mas redefinimos quem pode extrair valor dela e em qual velocidade. O Tyrell AI democratiza o acesso ao insight sem perder a profundidade analítica, reduz a dependência de fluxos manuais e transforma o Retail Intelligence em um sistema ativo, mais próximo de um radar do que de um relatório.

O resultado é uma mudança de paradigma: do dashboard como ponto de chegada ao copiloto como ponto de partida. Porque em um ambiente onde a vantagem competitiva depende de reagir antes do mercado, não ganha quem tem mais dados, mas quem melhor os converte em decisões.